這幾年輝達(NVIDIA)的名字出現在各個地方,就算你沒有投資輝達也可能知道是如何從單純的遊戲顯卡供應商,演變成全球 AI 基礎設施的龍頭。然而,常在新聞上聽到的 Vera Rubin、GB 300 、Blackwell 等產品名稱,但是你真的知道他們是做什麼的?長什麼樣子?產品之間又有何關聯嗎?今年推出的 Vera Rubin NVL72 又是怎麼組成?別擔心,股感將用本篇文章帶你一次看懂。

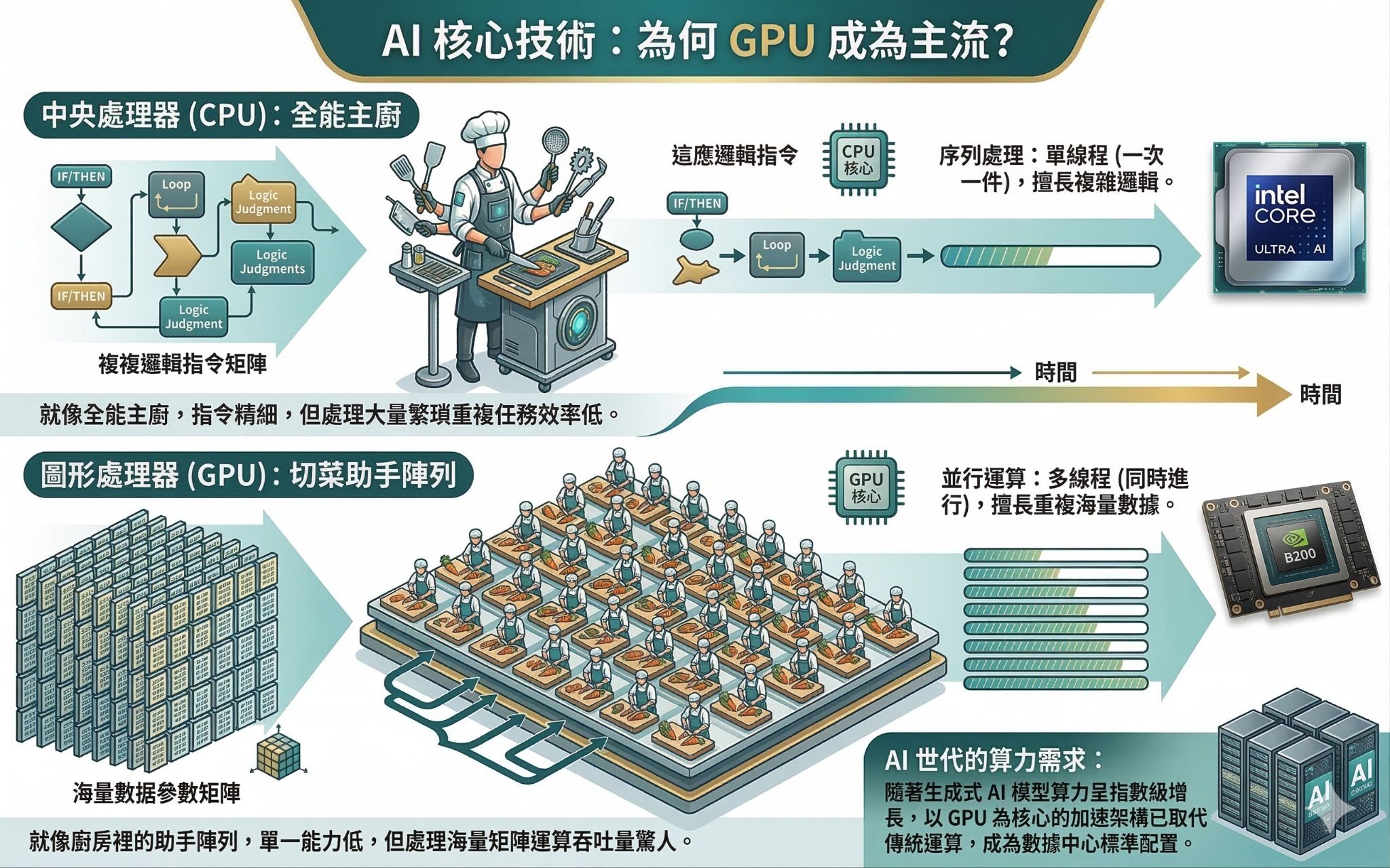

為何 GPU 成為主流?

在介紹輝達有哪些產品前,先帶讀者簡單回顧為何 GPU 如此重要。傳統的運算任務主要由中央處理器(CPU)負責,設計初衷是為了處理複雜的邏輯判斷與序列任務,就像是一位具備高度智慧的「全能主廚」,雖然能處理各種精細的指令,但在面對極度繁瑣且重複的任務時,效率便會受限。

相對而言,圖形處理器(GPU)的設計結構是為了「並行運算」而生。這就像是在廚房中部署了成千上萬名專門負責切菜的「助手」,雖然單一助手的邏輯能力不如主廚,但在處理 AI 訓練所需的海量數據(如數千億個參數的矩陣運算)時,GPU 能透過同步作業展現出驚人的吞吐量。

隨著生成式 AI 模型對算力的需求呈指數級增長,這種以 GPU 為核心的加速運算架構,正式取代傳統通用運算,成為數據中心的標準配置。

延伸閱讀 >>> GPU 是什麼?GPU 概念股有哪些?黃仁勳為什麼大推 GPU?

GPU 晶片架構的演進

進入到 AI 時代,輝達對自家 GPU 產品架構的命名在歷史上其實都確有其人,都是為了致敬歷史上偉大的科學家,代表技術世代的更迭。且每一代新架構的推出,通常伴隨著能源效率的提升與運算成本的下降。

| 股感資料庫整理 | ||||

| 輝達 GPU 產品架構演進 | ||||

| 晶片架構名稱 | 代表科學家 | 推出年份 | 量產年份 | 技術地位 |

| Ampere (A) | Ampere | 2020 | 2020 | 奠定現代 AI 運算基礎,廣泛應用於早期深度學習。 |

| Hopper (H) | Grace Hopper | 2022 | 2023 | 目前市場主流,支撐 ChatGPT 等 大型語言模型爆發。 |

| Blackwell (B) | David Blackwell | 2024 | 2025 | 2025 年的核心引擎, 大幅優化了推理效能與能耗比。 |

| Rubin (R) | Vera Rubin | 2026 | 2026 | 2026 年新旗艦, 專為具備獨立思考能力的「AI 代理」設計。 |

| Feynman (F) | Richard Feynman | 2028 | 2028 | 預計採用更先進的光子運算技術, 挑戰物理算力極限。 |

常聽到的 H200、B300之類的產品代號,前面的英文就是代表使用哪一代的 GPU ,像是 H300 就是使用 Hopper GPU,以此類推。

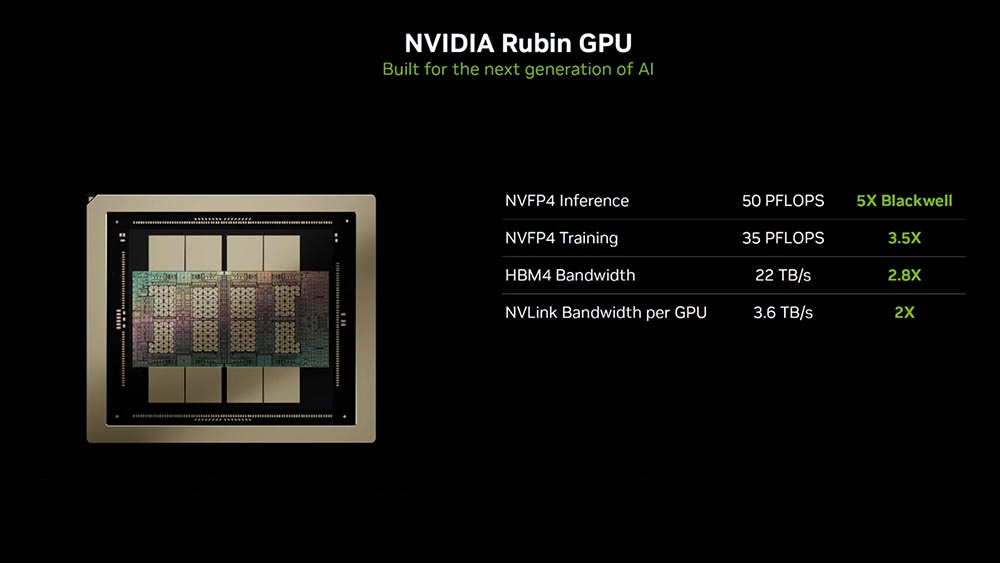

Rubin GPU

CPU 晶片架構的演進

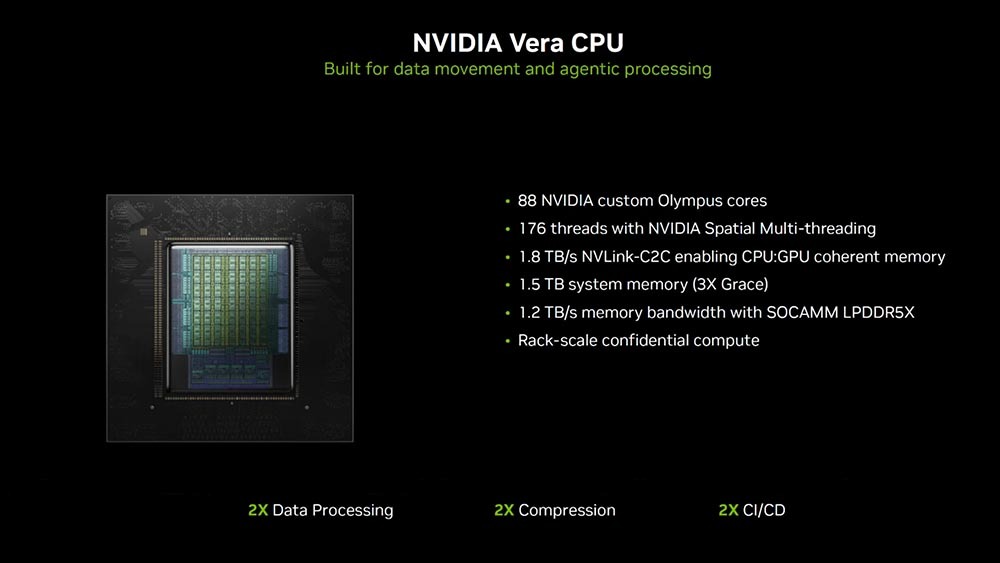

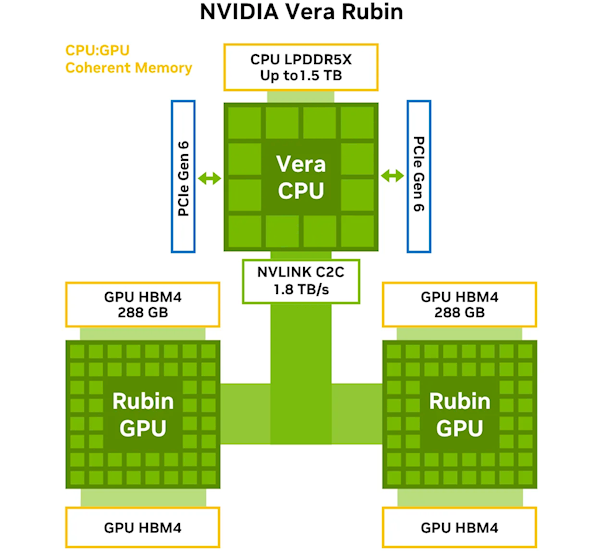

光只有運算出數據,如果沒有 CPU 來做數據調度也是不行。過去輝達與 IBM 合作,採用 IBM POWER CPU ,但近些年輝達改透過自研的 Arm 架構 CPU,直接一條龍生產,還透過 NVLink 解決傳統架構中資料在不同處理器間傳輸的瓶頸問題。

| 股感資料庫整理 | |||

| CPU 產品架構演進表 | |||

| CPU 系列代號 | 推出年份 | 量產年份 | 核心任務與市場價值 |

| Grace | 2022 | 2023 | 輝達首款專為超大規模數據中心設計的自研 ARM 架構處理器。 |

| Vera | 2026 | 2026 | 專門優化 AI 推理與複雜邏輯,確保 GPU 運算不被資料傳輸卡頓。 |

| Rosa | 2028 | 2028 | 預計採用 3D 封裝技術,與下一代 GPU 達成毫秒級的同步運作。 |

輝達 Vera CPU

AI 伺服器的組成

介紹完 GPU 、CPU 後,接下來介紹一台 AI 伺服器是透過哪些部件組成?一台頂配的 AI 伺服器售價已攀升至 300 萬美元左右,內部整合 GPU、CPU、HBM 高頻寬記憶體及先進液冷系統。 要理解一台具備高算力的 AI 伺服器,我們必須從最微小的晶片開始,像堆疊樂高一樣拆解它,我們可以把一台伺服器從小到大拆分成八大階層:

| 股感資料庫整理 | |||

| AI 伺服器硬體組成 | |||

| 階層 | 專有名詞 | 組成內容 | 圖片 |

| 1. 晶片 | GPU Die / Package | 運算晶粒、HBM 記憶體與中介層 (如 Rubin 晶片) |

|

| 2. 模組 | SXM / Superchip | 封裝後的 GPU 模組, 或 1 顆 CPU + 2 顆 GPU 整合 |

|

| 3. 基板 | UBB (Universal Baseboard) | 通常將 8 顆 GPU 模組併排 安裝在大型電路板上 |

|

| 4. 運算層 | Compute Tray (運算匣) | CPU + GPU 基板 + 系統記憶體 + 液冷板 |  |

| 5. 機箱 | Server Chassis (機箱) | 運算匣 + 外殼 + 電源供應器 (PSU) + 網卡 |

|

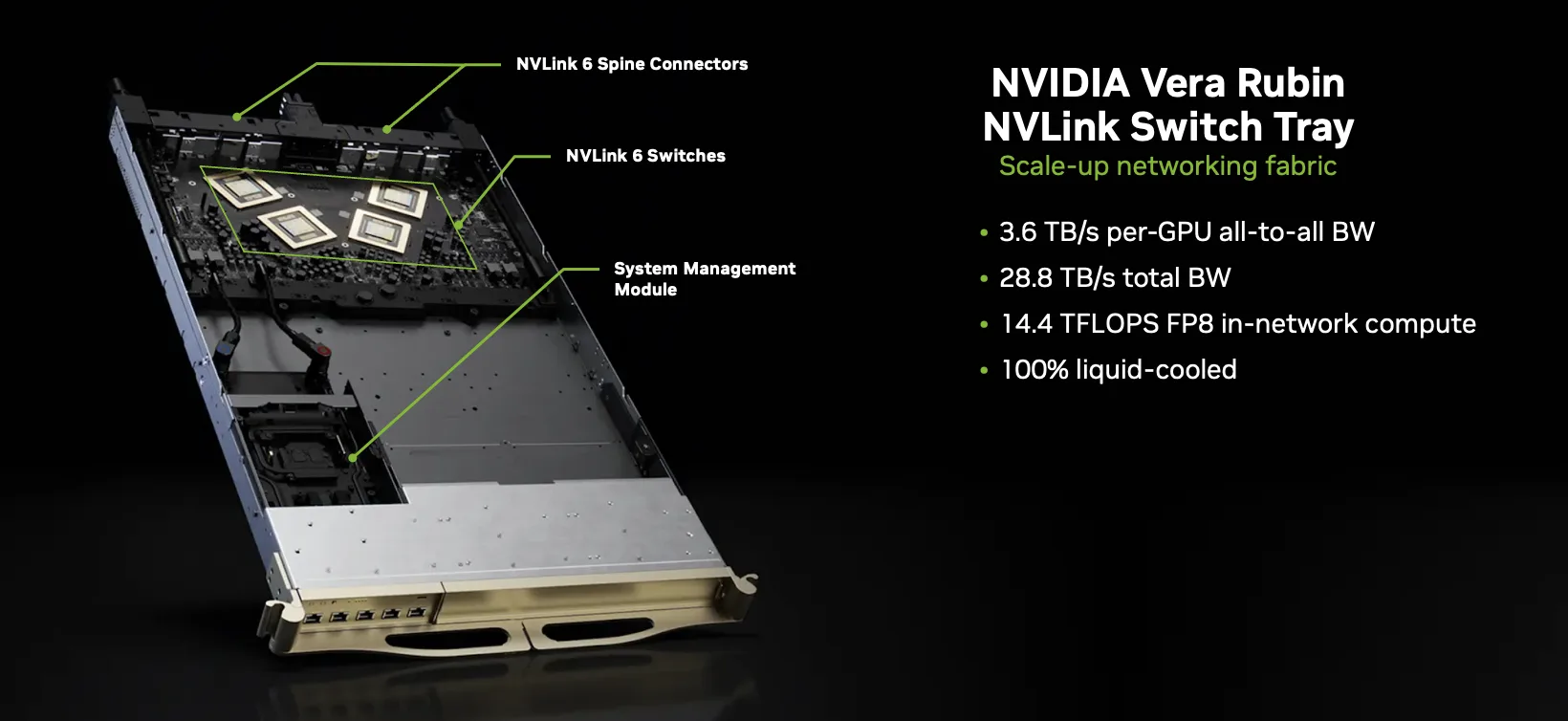

| 6. 交換機層 | NVLink Switch Tray | 專門負責 GPU 之間溝通的交換機模組 |  |

| 7. 機櫃 | AI Rack (如 NVL72) | 18~36 個運算匣透過 NVLink 串聯 |  |

| 8. 叢集級 | Cluster / SuperPOD | 數百個機架透過 InfiniBand 或乙太網串聯 |  |

以上這些內容會依照客戶所需來進行排列組合,並不是每一台機櫃內容都長得一樣。機櫃裡一層一層的單位被稱為「U」(Rack Unit),

- 1U/2U: 通常是通用型伺服器或交換機(瘦長型)。

- 4U/8U: 最常見的高度,因為裡面要塞進 8 顆發熱量巨大的 GPU 和大型散熱風扇。

以前追求伺服器越薄越好,但隨著算力提升,一個機櫃變的塞不下太多東西,像是 AI 伺服器的電源供應器 (PSU) 變得很龐大,也佔用了更多 U 數。另外還有散熱空間問題,狹長的機箱根本塞不下巨型散熱片,這也是為什麼水液冷散熱(Cold Plate)在近些年一直是熱門話題!

延伸閱讀 >>> 水冷散熱是什麼?水冷散熱概念股有哪些?水冷散熱概念股未來展望?

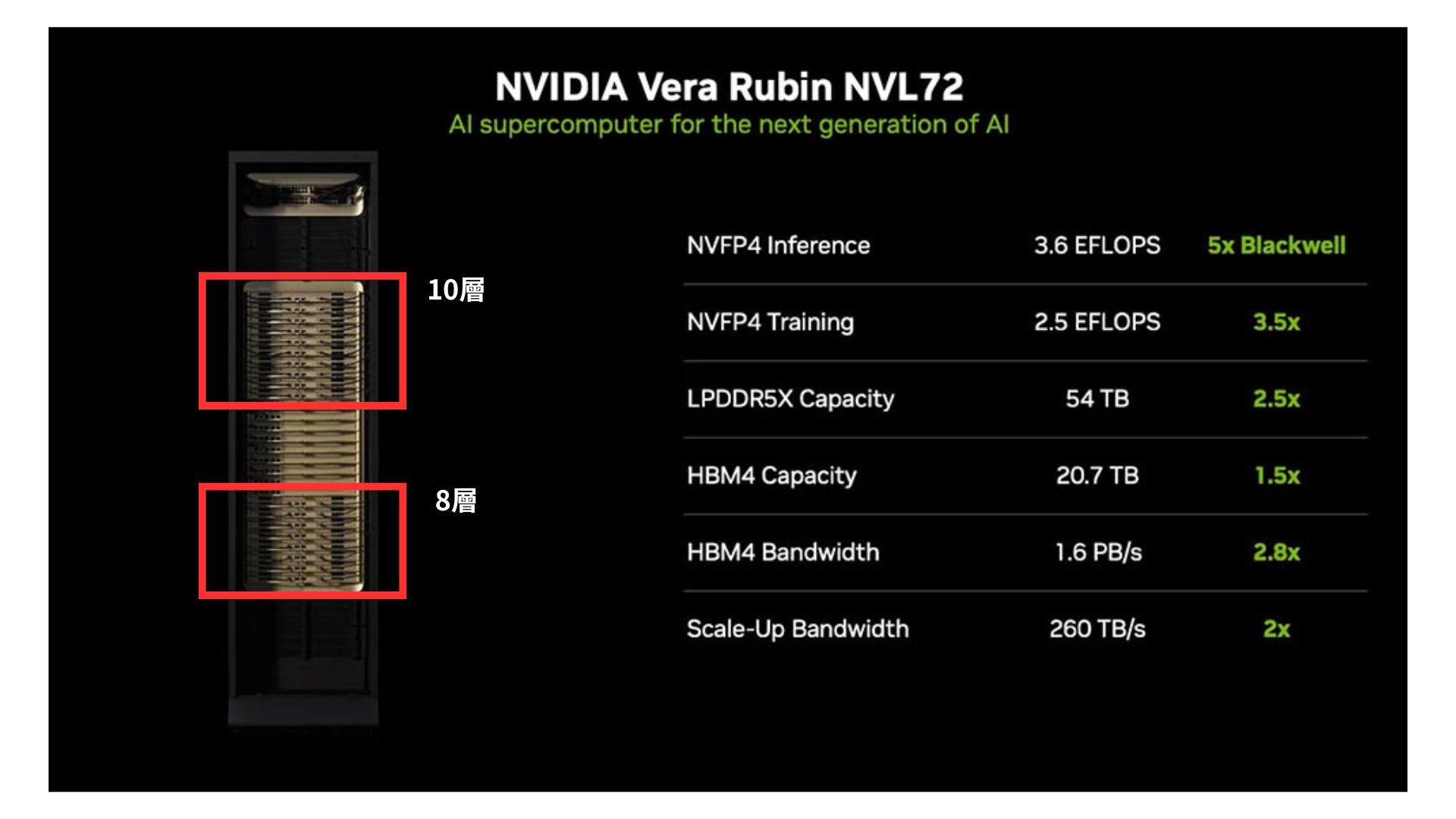

Vera Rubin NVL72

讓我們回到第七層 機櫃 (Rack),這時候就可知道 Vera Rubin NVL72 是代表什麼意思了!

上圖的機櫃中如果你仔細看可以看出有 18 層 Compute Tray (運算層),而 1 層 Compute Tray 又是由 2 顆「超級晶片」(Superchip)( 共 2 顆 Vera CPU 與 4 顆 Rubin GPU )進行封裝,也就是 18(Trays) x 4 (GPUs per Tray) = 72顆 (GPUs)。

你可能會問:「為什麼不湊個整數 80 或 100?」,這時候就要提到輝達獨家的 NVLink 高速互連技術。NVLink 就像是在 72 顆晶片之間搭建極寬的高速公路,再透過「銅線背板」(Copper Backplane)連接,讓數據傳輸的速度快到如同在「單一晶片」內部進行。這也是輝達最深的技術護城河:即便競爭對手能做出規格相近的單一晶片,也難以在這種「機櫃即電腦」(Rack-as-a-Computer)的大規模協同效率上與之匹敵,而是一個具備 72 顆 GPU 的單一運算實體。若是再透過 Scale-out 串連其他機櫃,則運算效能就不只翻倍這麼簡單了!

透過這種從小組合到大的精密階層,最後組合成 AI 資料中心,將數十億個電晶體的微小力量,整合並轉化為足以改變世界的巨大算力中心。

產品線分類

前面提到的都是機櫃式伺服器,不同的產業有不同的使用情境,也不是每個客戶都有獨立的機房來儲放伺服器,為此輝達針對不同規模的客戶與應用場景,將產品線區分為許多類別,股感只列出其中幾項:

| 產品線分類 | |||

| 產品系列 | 主要客群 | 解決方案與優勢 | 圖片 |

| DGX 系列 |

頂尖研究機構、企業、個人 | 輝達原廠旗艦機,強調軟硬體深度調優,客戶買回後可立即投入 AI 研發。 |  |

| HGX 系列 |

AWS、微軟、Google 等雲端服務商 | 提供核心架構藍圖,讓雲端巨頭能根據其資料中心環境進行彈性客製化。 |  |

| OVX 系列 |

汽車設計、數位孿生、智慧建築 | 專為模擬虛擬世界設計,協助企業在實體動工前進行萬次的虛擬演練。 |  |

| IGX 系列 |

醫療手術室、工業自動化工廠 | 強調邊緣運算的穩定性與安全性,適用於對震動、溫度較敏感的嚴苛環境。 |  |

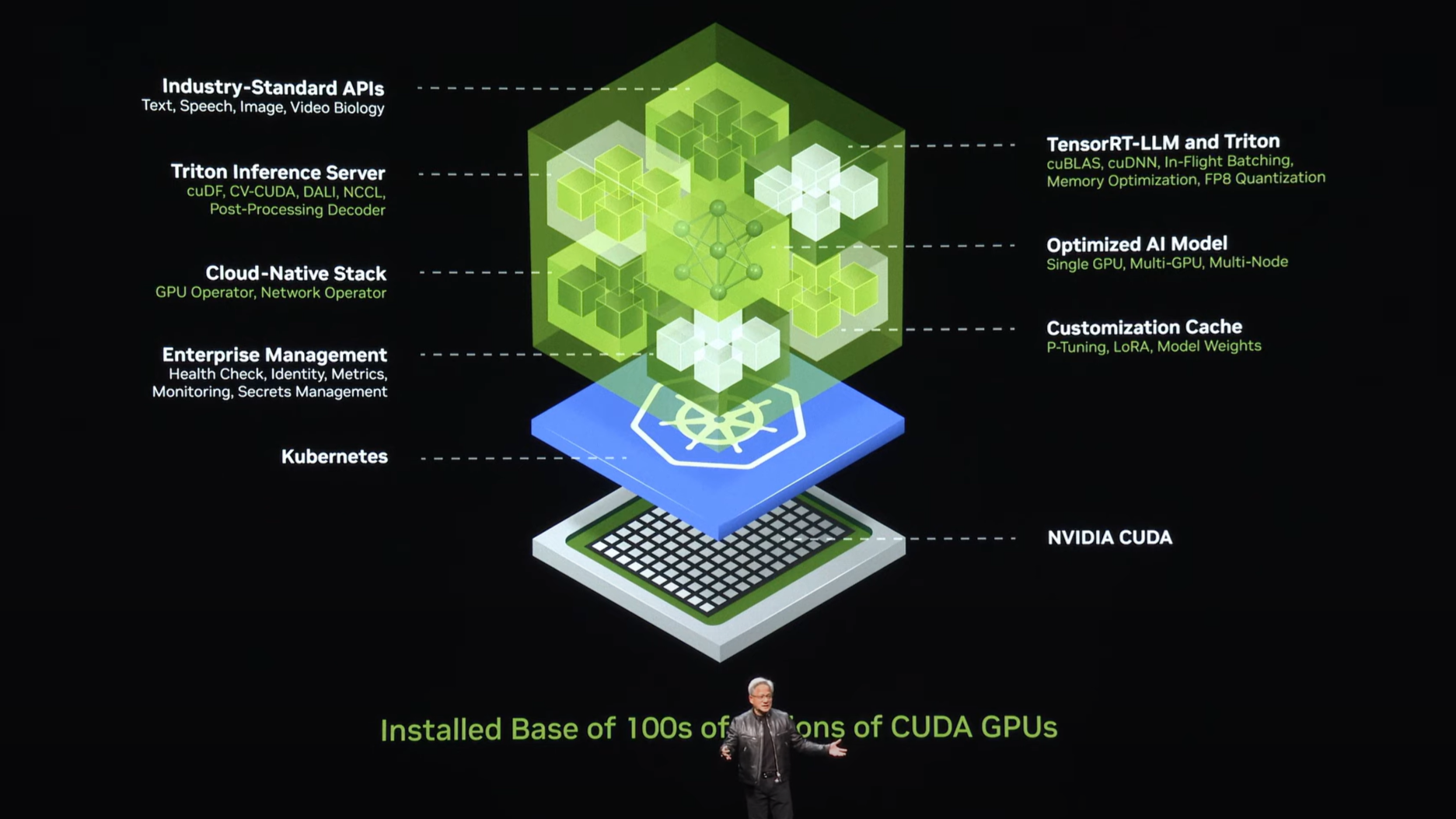

CUDA 與軟體生態

硬體效能固然重要,但輝達真正的護城河來自名為 CUDA 的軟體開發平台。在過去 20 年間,全球數百萬名工程師已習慣在 CUDA 架構下撰寫程式碼與訓練模型。這產生極強的路徑依賴:如果一家企業想轉用其他品牌的晶片,其所有的軟體、開發工具與過往積累的演算法都必須重新改寫。這種極高的轉換成本,讓輝達在硬體銷售之外,建立了一個無人能撼動的生態圈。

輝達還推出的 NIM(AI 微服務)將複雜的 AI 模型進行標準化封裝,讓企業能更快速地在現有系統中部署與執行。這項服務降低了企業導入 AI 技術的難度,同時也讓輝達的軟體與硬體之間能有更緊密的整合,提升整體運算效率。

2024 Computex

為何難以撼動輝達的地位?

市場上其實也不是只有輝達在做伺服器市場,市場上也有許多挑戰者,但為什麼比不過呢?因為輝達的領先優勢已從單純的「晶片運算速度」轉向「系統級的生態壟斷」。我們拿輝達最強勁競爭對手:AMD(超微)進行深度對比。

AMD (MI300/400 系列)

AMD 的產品(如 MI300X 及其後續的 MI400 系列)在硬體規格上非常強悍,特別是在記憶體容量與頻寬上,時常能與輝達的旗艦產品持平甚至超越。然而,AMD 面臨的最大挑戰在於軟體生態圈(ROCm)。全球絕大多數的 AI 開發者都是在輝達的 CUDA 架構下成長,對於開發者而言,轉換到 AMD 平台需要耗費大量的時間進行程式碼優化與適應,有極高的隱形成本。

| Nvidia 與 AMD 對比 | ||

| 競爭維度 | 輝達 (NVIDIA) | AMD (超微) |

| 軟體成熟度 | 極高 (CUDA 生態系完整) | 中 (ROCm 持續追趕中) |

| 硬體通用性 | 極強 (適用於各類 AI 任務) | 強 (適合大規模推理) |

| 互連技術 | NVLink (獨家通訊協定) | Infinity Fabric (開放標準) |

| 市場策略 | 全通路銷售 (硬體 + 系統) | 硬體銷售、性價比取勝 |

數據中心業務如何驅動輝達的估值?

從財務指標來看輝達的財報,市場觀察的指標早就不再是遊戲顯卡的銷量,而是數據中心(Data Center)業務的成長曲線。

根據 2025 年至 2026 年的市場預估,輝達在 AI 資料中心 GPU 市場的佔有率仍維持在 85% 至 90% 的絕對領先地位。而毛利率(Gross Margin)長期穩定在 70% 以上,這在硬體產業是極為罕見的數字,反映輝達對產品有極強的定價能力。

| 輝達營收結構與市場佔有率概況 | |||

| 業務項目 | 營收佔比 (預估) | 市場佔有率 | 增長動能分析 |

| 數據中心 (Data Center) | 85% – 88% | 約90% | 由 Rubin 平台與 NVL72 整機櫃方案帶動的高客單價需求。 |

| 遊戲 (Gaming) | 8% – 10% | 約75% | 雲端遊戲與高階 PC 換機潮提供的穩定現金流。 |

| 專業視覺化 (Visualization) | 2% – 3% | 約90% | 企業級數位孿生與 OVX 平台的軟體授權收入。 |

| 汽車與機器人 (Auto) | 1% – 2% | 成長中 | DRIVE 與 Jetson 平台在自駕車市場的長期佈局。 |

輝達的營收已經高度集中於數據中心業務。這意味著輝達的股價與全球大型科技股(如 Meta, Microsoft, Alphabet)的資本支出(CapEx)呈現高度正相關。只要全球巨頭繼續投入 AI 基礎設施的競賽,輝達作為「軍火供應商」的角色就不會改變。

輝達近年來積極推動「軟體訂閱制」(如 NVIDIA AI Enterprise),把原本一次性的硬體銷售轉化為持續性的經常性收入。這類高毛利的軟體服務,也是未來提升輝達長期估值的重要看點。

結論

看完以上對 AI 伺服器的拆解,下次讀者再看到介紹輝達的產品時不會太過陌生,至少清楚這些產品是做什麼的,或是使用了哪些晶片。如果你有在跟進時事你會發現,近幾年的 GTC 大會上除了公布最新的晶片架構外,輝達執行長黃仁勳也推出許多 AI 的實體應用:像是去年的星際大戰 「BB8」、今年與迪士尼合作的「雪寶」,搭載針對機器人設計的 Jetson 系列,賦予機器精密的核心控制與環境感知,讓 AI 真正擁有「肢體」。還有專為自動駕駛研發的 DRIVE 系列,把強大的運算力注入移動載具,讓交通工具具備自主思考能力,以上種種都說明輝達的佈局慢慢跨越數位世界的藩籬,輝達不再只是一家單純的硬體供應商,而是透過定義軟硬體標準,成為整個 AI 時代的作業系統!

【延伸閱讀】